LATEST ARTICLES

¿Renaper sufrió nuevo hackeo masivo? Esto es lo que se sabe hasta el momento

En las últimas horas -- o par de días -- han saltado las alarmas. El Registro Nacional de las Personas (Renaper), organismo dependiente del Ministerio del Interior de Argentina, habría sufrido una brecha de seguridad. O quizás más de una. El panorama es poco claro y demasiado confuso. Ante esto, nos vemos en la necesidad de tratar de recapitular la...

Cómo funciona el plan canje de Motorola

Hice la experiencia de canjear un teléfono viejo por uno nuevo más la diferencia en el programa de Canje de Motorola. ¿Valió la pena? ¿Me dieron lo suficiente por el teléfono viejo? Cambié un Moto One Hyper por un flamante Moto G14 y aquí les muestro cómo fue la experiencia paso a paso. No es un video esponsoreado, aclaro, pagué mi propio...

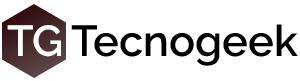

Adiós Atlas, hola nuevo Atlas

Boston Dynamics, ahora una empresa de Hyundai, le dice adiós a su "viejo" robot Atlas para presentarnos uno totalmente nuevo 100% eléctrico. ¿es que el otro no lo era? Pues no, gran parte del movimiento elástico lo hacía con pistones hidráulicos, esta nueva versión, mejorada, apunta no sólo a utilizar sólo servos eléctricos sino que ya tiene en miras la...

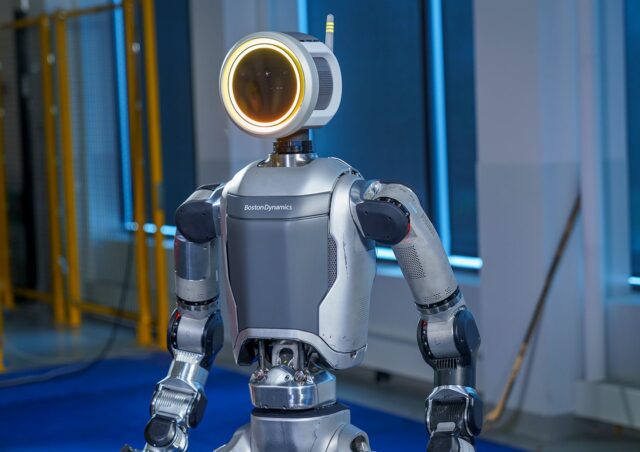

Encontrado el segundo agujero negro más grande de la Vía Láctea

Los agujeros negros se clasifican en dos categorías principales: los supermasivos que se encuentran en los centros de las galaxias y los de masa estelar formados a partir de supernovas de estrellas muy masivas. Antes de los detectores de ondas gravitacionales, los agujeros negros estelares más masivos conocidos tenían alrededor de una docena de veces la masa del Sol....

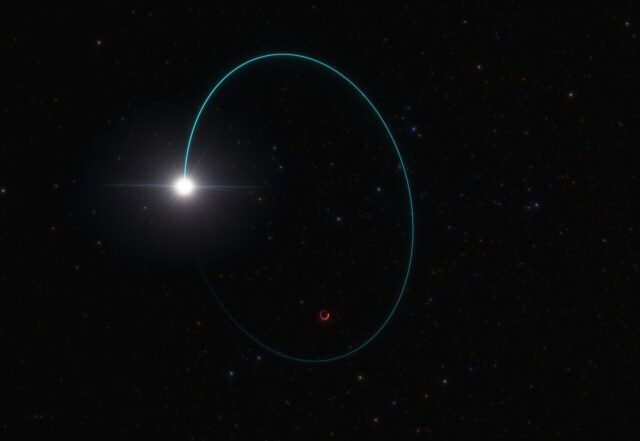

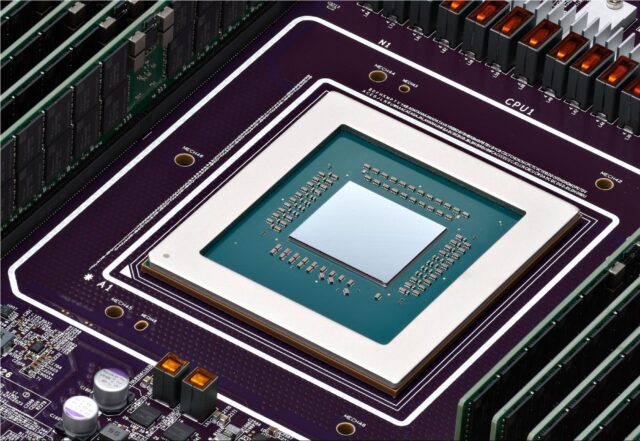

Intel anuncia Gaudi 3 para competir contra NVidia en AI

Intel sabe que hay un mercado gigante del cual no puede perder la oportunidad y Gaudi 3 sería su procesador para tratar de arrañar un poco del negocio de NVidia. Durante los últimos meses NVidia creció y se revaluó de una forma increíble gracias a sus GPU orientados a servidores y AI, si blockchain y esas cosas quedaron en el...

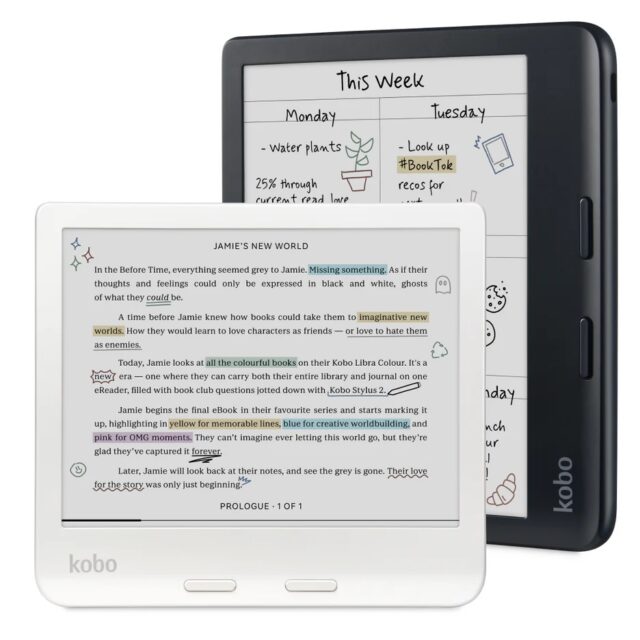

Kobo le da color a sus e-readers

Admito que soy muy fan de los ereaders por sus pantallas de e-ink, pero más aun fantaseo con pantallas color como las que Kobo trae ahora! A partir del 30 de abril podremos adquirir la Kobo Clara Colour por unos USD 149.99 o la Kobo Libra Colour por USD 219.99, similares a sus predecesoras blanco y negro, pero a color! La...

Olvídate de la obsolescencia programada: Fairbuds, los audífonos sostenibles que te durarán años

¿Cansado de auriculares que se rompen o cuyas baterías mueren después de un año? Fairphone, la marca de smartphones sostenibles, entra al mundo del sonido con los Fairbuds, unos audífonos inalámbricos que rompen el molde. Olvídate de comprar un set completo porque se te perdió un auricular. Con Fairbuds, puedes reemplazar solo la pieza que necesites. ¿La batería te está...

Google anunció su procesador para datacenters Google Axion

Apenas comenzado el evento Google Cloud Next 2024 la empresa anunció el Google Axion, su propio diseño de CPU para datacenters basado en ARM, especialmente usando el diseño de ARM Neoverse V2. Google ya viene creando sus propios CPUs, sea por un lado para los Google Pixel o para procesamiento de Tensors de Inteligencia Artificial, así que era obvio que...

Edge 50 Pro de Motorola saldría al mercado global el 16 de abril

Motorola anunció días atrás al Edge 50 Pro. El mismo supone su último smartphone puntero (a falta de una versión Ultra). Sin embargo, la presentación quedó limitada para India. Peeero, eso parece estar por cambiar. Todo surgió como base de una publicación en Amazon Alemania. Desde el medio Gizmochina llega la siguiente una captura: En la imagen de arriba, dos cosas...

Pixel 8a: sus especificaciones aparecen filtradas al detalle

Se siente cada vez más latente. El Pixel 8a apunta a constituir el próximo smartphone de Google. Al ser de la familia Xa, supondría un híbrido de gama media y alta. Otorgaría buenas características a un precio considerable. A eso habría que sumar su fuerte en fotografía y software. Esa espera cada vez es más palpable. Y esto lo decimos...